Se hai bisogno di dati a lungo termine, come il sentiment dei competitor o tweet storici di anni fa, e di una pipeline sempre attiva, la scelta si riduce spesso a due opzioni: lo scraping Twitter e le API ufficiali di Twitter.

L’API è affidabile ma può costare migliaia di dollari al mese, mentre lo scraping manuale è economico ma fragile, afflitto da blocchi IP e continue interruzioni.

Questa guida analizza il problema principale che gli esperti di dati e le aziende affrontano oggi: il rapporto tra quanto costa e quanto ci si può fidare della soluzione adottata.

Non cerchiamo solo di esportare i dati una singola volta. Vogliamo monitorarli a lungo termine: poter osservare i dati per sei, dodici o ventiquattro mesi senza alcuna interruzione.

Che tu sia uno sviluppatore che valuta uno script Python o un manager in cerca di strumenti aziendali, questa guida analizzerà i costi reali, i rischi e la sostenibilità di ciascun approccio, per aiutarti a scegliere la soluzione che funzionerà davvero nel lungo periodo.

Risposta rapida

Per il monitoraggio a lungo termine di Twitter (X), le API ufficiali offrono la massima affidabilità ma a costi proibitivi, mentre lo scraping fai-da-te è più economico ma instabile e dispendioso in termini di risorse.

Per la maggior parte delle aziende, gli strumenti di scraping no-code come Octoparse offrono il miglior equilibrio tra costi, affidabilità e scalabilità, rendendoli la soluzione più pratica per raccogliere continuamente dati storici e in tempo reale senza un pesante carico ingegneristico.

Comprendere lo scraping di Twitter

Ottenere dati da Twitter, ora chiamato X, richiede un metodo automatizzato per estrarre informazioni. Questo avviene simulando l’interazione di una persona con il sito o l’app mobile. Un’API restituisce dati facilmente leggibili dai computer, come i file JSON, quando richiesti. Lo scraping è diverso. Significa caricare le pagine web e visualizzare il contenuto HTML. Successivamente, preleva ciò che è visibile e lo organizza in un formato di dati strutturato.

Metodi comuni di scraping

- Automazione del Browser tramite Codice: Selenium e Playwright sono strumenti che controllano un vero browser web (come Chrome o Firefox). Possono accedere, navigare in una timeline, selezionare “Mostra altro” e copiare il testo sullo schermo. Questo è l’approccio più diffuso, poiché Twitter fa un uso massiccio di JavaScript per mostrare i contenuti, rendendo inefficaci le normali richieste HTTP.

- Intercettazione delle Richieste HTTP: Gli scraper più complessi decodificano le chiamate API interne che il sito web di Twitter effettua ai propri server. Gli scraper possono ottenere i dati più rapidamente emulando queste query “non ufficiali” piuttosto che caricando l’intera interfaccia visiva.

- Strumenti di Scraping di Terze Parti: Software preconfigurati o piattaforme SaaS gestiscono le complessità al posto tuo, fornendo un’interfaccia semplice in cui inserire un URL e scaricare un CSV. Come alternativa all’approccio Python, strumenti no-code come Octoparse offrono un’automazione completa del browser, particolarmente utile su siti web come Twitter.

Quali dati possono essere estratti da Twitter?

Praticamente qualsiasi cosa visibile a un utente loggato può essere estratta. Questo include la possibilità di convertire thread di x in testo per analisi approfondite, oltre a:

- I contenuti dei tweet, inclusi testo, hashtag, cashtag ed emoticon.

- I file multimediali, come link a immagini e video.

- Le metriche di engagement, inclusi i conteggi pubblici di like, retweet, risposte e visualizzazioni.

- Le informazioni del profilo, come numero di follower, biografie, date di iscrizione e posizioni geografiche.

- I metadati, inclusi timestamp, dispositivo di origine (ove applicabile) e ID dei tweet.

Requisiti tecnici

Uno script da solo non è sufficiente per uno scraping Twitter efficace. Poiché X impiega rigorosi metodi anti-bot, è necessario uno stack tecnologico che includa:

- Rotazione dei Proxy: L’uso di una rete di indirizzi IP residenziali per evitare che il tuo scraper venga bloccato dopo poche centinaia di richieste.

- I browser headless sono browser che funzionano in background per eseguire JavaScript.

- Gestione delle Sessioni: La gestione di cookie e “token di autenticazione” per mantenere uno stato di login, dato che Twitter ora richiede l’accesso per visualizzare praticamente tutte le informazioni.

In sintesi, lo scraping fornisce un accesso diretto e senza filtri ai dati pubblici, superando i limiti artificiali del piano API gratuito, ma comporta anche un notevole “sovraccarico” tecnologico per mantenere il sistema funzionante.

Comprendere le API di Twitter

L’API di Twitter (ora API di X) è il gateway approvato per gli sviluppatori per accedere ai dati delle conversazioni pubbliche della piattaforma. Permette alle app di connettersi con Twitter in modo programmatico, rispettando le rigorose restrizioni e i limiti di frequenza dell’azienda.

Prezzi delle API di Twitter: il modello di accesso a livelli

Dalla fine del 2023, la struttura delle API è passata a un approccio a livelli ad alto costo che distingue chiaramente tra utenti occasionali e aziende:

- Livello Gratuito: È essenzialmente un livello di “sola scrittura”. Permette un numero limitato di tweet (circa 1.500 al mese) ma non fornisce alcun accesso, o quasi, ai dati dei tweet. È inutile per il monitoraggio.

- Livello Base ($100/mese): Progettato per amatori e prototipi. Offre un modesto limite di lettura (ad esempio, 10.000 tweet al mese). Questa quota può essere esaurita in un solo giorno se un brand monitora le menzioni 24 ore su 24.

- Livello Pro ($5.000/mese): Questo è il punto di ingresso per l’accesso commerciale ai dati. Fornisce circa 1 milione di tweet al mese e l’accesso all’intera ricerca in archivio (dati storici).

- Livello Enterprise ($42.000+/mese): Limiti personalizzati, supporto account dedicato e il massimo grado di affidabilità.

Gestire i limiti per richiesta di Twitter

Le API interne e le timeline di Twitter impongono limiti rigorosi sulla quantità di dati che puoi ricevere in una singola richiesta o sessione di scorrimento. Se provi semplicemente a “scorrere fino in fondo” o a lanciare una grande query, raggiungerai questi limiti molto prima di ottenere tre anni di cronologia: il browser diventa instabile, le richieste vanno in timeout o la piattaforma smette silenziosamente di restituire i tweet più vecchi.

Per aggirare questo problema in modo affidabile, i modelli per Twitter di Octoparse non cercano di catturare tutto in una volta. Al contrario, dividono automaticamente l’attività per intervalli di date (ad esempio, giorno per giorno) in base a come configuri il lavoro. Ogni esecuzione si concentra su una finestra temporale più piccola, il che:

- Rispetta i limiti per richiesta e di timeline di Twitter,

- Riduce il rischio di crash o troncamenti silenziosi, e

- Massimizza la quantità di dati storici completi che puoi effettivamente raccogliere.

Per gli utenti finali, questa suddivisione basata sulle date è invisibile: devi solo definire l’intervallo di tempo complessivo (come “gli ultimi tre anni”) e Octoparse orchestra diverse piccole esecuzioni in background per assemblare l’archivio di tweet più completo possibile.

Soluzioni no-code: la terza via per il monitoraggio dei dati Twitter

Per il 90% degli utenti, come agenzie di marketing, ricercatori e piccole/medie imprese, costruire uno scraper Python o pagare $5.000 al mese è fuori discussione. Questo ha portato alla nascita delle soluzioni di scraping no-code.

Queste soluzioni gestiscono l’infrastruttura (proxy, browser, evasione dei sistemi anti-bot) e forniscono un’interfaccia semplice per recuperare i dati. Funzionano efficacemente come una “API di scraping” e permettono persino di collegare x a google sheets tramite webhooks per automatizzare i flussi di lavoro.

L’approccio allo scraping Twitter no-code:

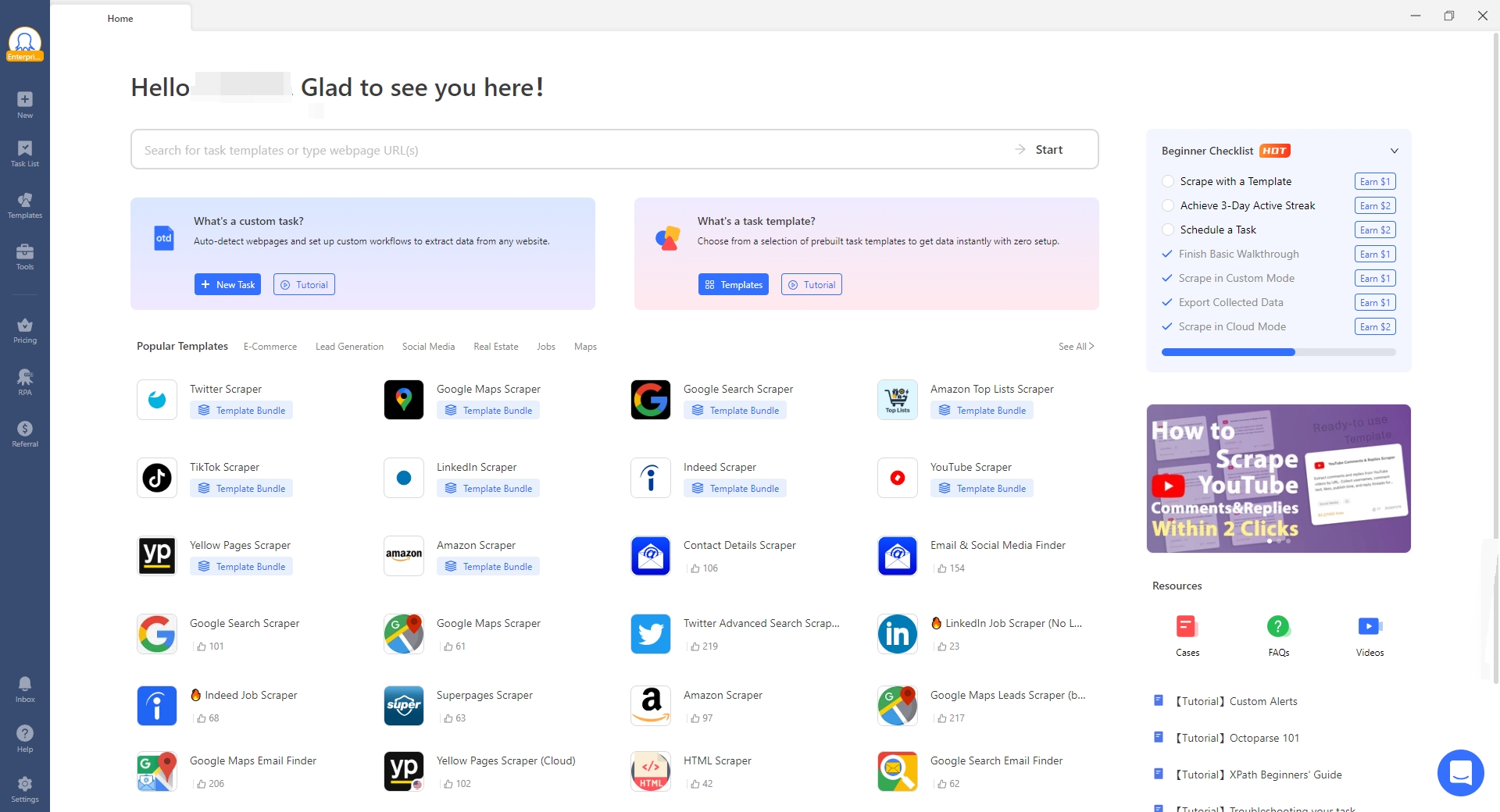

Uno strumento di web scraping con un’interfaccia visiva e template pronti all’uso. Puoi scaricare l’app desktop di Octoparse, scegliere un template “Twitter” preconfigurato, inserire gli URL o le parole chiave desiderate, ed eseguire l’azione nel cloud.

Vantaggi dell’uso di Octoparse per fare scraping su Twitter

Automazione integrata e capacità anti-bot

Esegue automaticamente il rendering complesso di JavaScript e supporta lo scorrimento infinito. Incorpora funzionalità come la rotazione degli IP e l’estrazione in cloud per garantire che le attività di monitoraggio a lungo termine non vengano bloccate. Costa sostanzialmente meno rispetto all’API ufficiale.

Monitoraggio affidabile di Twitter a lungo termine

Octoparse e altri scraper no-code per Twitter come Chat4Data e Instant Data Scraper aiutano a colmare il divario. Offrono uno scraping a basso costo unito all’affidabilità di un servizio gestito. Quando l’interfaccia utente di Twitter cambia, il team di Octoparse (o i manutentori dei template) aggiorna lo scraper, non tu. Puoi configurare un lavoro per l’esecuzione oraria, e i risultati vengono inviati al tuo database tramite un webhook o un’API.

Confronto diretto: scraping Twitter vs API di Twitter

| Caratteristica | API Ufficiale di Twitter (Pro) | Scraping Python/Fai-da-te | No-Code (es. Octoparse) |

| Tempo di Setup | < 1 Giorno (Chiavi API) | 3-7 Giorni (Sviluppo e Test) | < 2 Ore (Template) |

| Costo Mensile | ~$5.000/mese (Livello Pro) | ~$200/mese (Proxy + Server) | ~$100-$300/mese (Piani Standard/Pro) |

| TCO a 12 Mesi | $60.000+ (Inoltre, qualcuno che lo configuri) | $2.400 + $50.000 (Stipendi Sviluppatori) | $1.200 – $3.600 |

| Manutenzione | Nessuna (Molto Bassa) | Alta (Correzioni settimanali) | Bassa (Gestita dal provider) |

| Affidabilità Dati | 100% (Gold Standard) | 60-80% (Soggetto a interruzioni) | 90-95% (Alta) |

| Competenza Tecnica | Media (JSON/OAuth) | Alta (Python/Selenium) | Bassa (Punta e Clicca) |

| Rischio | Zero (Ufficiale) | Alto (Ban/Blocchi IP) | Basso (Proxy Gestiti) |

Per aiutarti a decidere, ecco un riepilogo dei tre approcci distribuiti su un progetto di monitoraggio di 12 mesi.

Scenario: Monitoraggio di 2.000 tweet al giorno (circa 60.000 al mese) per un anno.

Conclusione

In un’ottica a lungo termine, ecco il quadro decisionale:

- Se hai un budget annuale di $60.000, scegli l’API Ufficiale Twitter Enterprise/Pro. È l’unica opzione per ottenere rapidamente una “cronologia di 3 anni” garantita senza alcuna restrizione.

- Se hai ingegneri ma nessun budget extra, puoi provare lo scraping Python, ma attenzione: ottenere tre anni di dati storici scorrendo le pagine è piuttosto complicato e soggetto a errori. Molto probabilmente incontrerai blocchi per “limite di frequenza” prima di finire il primo anno di dati.

- La raccomandazione equilibrata: Per la maggior parte dei casi d’uso solidi, uno scraper No-Code/SaaS come Octoparse è l’ideale.

- Dati storici: Può automatizzare la funzione di ricerca per localizzare i tweet di periodi di tempo specifici.

- Monitoraggio continuo: Puoi impostare attività da eseguire ogni giorno per catturare i nuovi tweet.

Domande frequenti sullo scraping Twitter e le API di Twitter

- Fare scraping su Twitter è legale o verrò denunciato?

Sebbene X (Twitter) abbia perso cause legali che cercavano di impedire alle aziende di raccogliere dati pubblici, mantiene l’autorità di sospendere il tuo account e bloccare il tuo indirizzo IP per violazione dei loro termini di servizio.

È consigliabile estrarre tweet pubblici senza effettuare l’accesso (il che è difficile da realizzare in questo momento) o visualizzare profili pubblici con account usa e getta. L’estrazione di dati privati, messaggi diretti o l’uso del tuo account aziendale principale può mettere a rischio di sospensione la presenza ufficiale del tuo brand.

- Posso davvero ottenere 3 anni di dati storici senza pagare $42.000 per l’API Enterprise?

Sì, ma richiede pazienza e gli strumenti giusti.

- API ufficiale: Il livello “Pro” ($5.000/mese) dà accesso alla Ricerca Completa in Archivio, permettendoti di estrarre istantaneamente i tweet dal 2021. Il livello “Basic” ($100/mese) cerca solo negli ultimi 7 giorni.

- Scraping: Uno scraper può andare indietro di 3 anni utilizzando i parametri della ricerca avanzata twitter (es. from:utente since:2024-01-01 until:2026-12-31). Tuttavia, non puoi semplicemente “scorrere verso il basso” per tre anni; il browser andrà in crash. Per gestire con successo l’impaginazione, devi suddividere il processo in parti più piccole (ad esempio, mese per mese) e utilizzare uno strumento come Octoparse.

- Perché non posso usare semplicemente il livello API “Basic” da $100 per il monitoraggio?

Il livello Basic ti permette di leggere solo 10.000 tweet al mese. Se stai seguendo un brand popolare o un argomento in tendenza, puoi superare quel limite in un solo pomeriggio. Una volta raggiunto il limite, il tuo flusso di dati viene interrotto fino al mese di fatturazione successivo. Per un monitoraggio continuo a lungo termine, in cui i vuoti di dati sono inaccettabili, il livello Basic raramente è sufficiente.

- Il mio account personale su Twitter verrà bannato se lo uso per lo scraping?

Sì, è molto probabile. Se utilizzi le tue credenziali personali (cookie) in uno script Python o in uno strumento di scraping, gli algoritmi anti-bot di Twitter rileveranno attività “non umane”. Tali attività di solito includono l’accesso rapido a link, il clic su pulsanti o la compilazione di moduli.

Non usare mai il tuo account principale. I progetti di monitoraggio seri utilizzano un pool di account “usa e getta” o, ancora meglio, una piattaforma no-code come Octoparse, che gestisce sessioni e proxy per tuo conto, mantenendo la tua identità separata dall’attività di estrazione.

- Perché dovrei pagare per uno strumento come Octoparse quando potrei semplicemente assumere uno sviluppatore Python?

Tutto si riduce ai costi di manutenzione. Uno script Python scritto oggi probabilmente smetterà di funzionare la prossima settimana quando Twitter aggiornerà il codice del suo sito web (ad esempio, cambiando il nome di una classe).

- Python: Puoi sempre assumere uno sviluppatore per mantenere e correggere costantemente lo script, ma devi anche pagare separatamente per server e proxy, che diventano più costosi man mano che cresci.

- No-Code (Octoparse): La manutenzione è delegata e gestita interamente dalla piattaforma. Se il layout di Twitter cambia, il team di Octoparse aggiornerà tempestivamente il template. Paghi una quota mensile fissa per uno strumento funzionante piuttosto che una tariffa incerta per aggiornare codice e infrastruttura non funzionanti.

Al confronto, gli strumenti no-code come Octoparse sono molto più convenienti, specialmente per le aziende più piccole.

- Quali sono le opzioni più veloci per fare web scraping su Twitter?

Le API sono le più veloci, ma la maggior parte degli utenti sceglie strumenti no-code o cloud per prestazioni pratiche e stabili. Alcuni web scraper come Octoparse (scopri Octoparse MCP qui), offrono MCP che possono connettersi agli LLM per lo scraping basato sull’AI, rendendo il tutto più veloce, conveniente e facile per chi non sa programmare.

- Il più veloce in assoluto: API Ufficiale di X → massima velocità, costo più alto

- Miglior equilibrio (velocità + costo): Scraper cloud (es. Apify)

- Il più veloce da configurare: Strumenti no-code come Octoparse, Chat4Data

- Veloce in teoria, instabile: Script fai-da-te (Playwright, Puppeteer)